GTC 2026 de NVIDIA: La carrera armamentista de poder de cómputo para la próxima curva S de la IA

La conversación ha cambiado. Antes se trataba de "¿Qué podemos hacer con la IA?". Ahora, la pregunta urgente es "¿Cómo pasamos de la experimentación al impacto?". Este giro señala una maduración: pasamos de la novedad a la necesidad. La curva de adopción se ha vuelto exponencial. Una herramienta líder de IA generativa alcanzó cerca del doble de usuarios que Internet en siete años, en solo dos meses. Al momento de escribir esto, esa herramienta ya cuenta con más de 800 millones de usuarios semanales, aproximadamente el 10% de la población mundial. Eso no es solo crecimiento rápido; es la firma de una tecnología que ha alcanzado masa crítica y se está volviendo fundamental.

Este es el punto de inflexión. Cuando una herramienta llega a tal escala, el enfoque se traslada de probar su existencia a construir la infraestructura que soporte su impacto. El ciclo de innovación compuesta—mejor tecnología permitiendo más aplicaciones, generando más datos y atrayendo más inversión—ha adquirido un impulso imparable. Para las empresas, esto significa que los modelos antiguos ya no sirven. La infraestructura diseñada para estrategias cloud-first no puede manejar la economía de la IA. Los procesos ideados para trabajadores humanos no funcionan para agentes automatizados. Los modelos de seguridad basados en la defensa perimetral no protegen contra amenazas a velocidad de máquina. La era del mejoramiento ha terminado; estamos en la era de la reconstrucción.

Por eso el marco conceptual de Jensen Huang es tan potente. Él llama a la IA "infraestructura esencial". Ese es el fundamento de la tesis de inversión a largo plazo. Cuando una tecnología se vuelve tan fundamental como la electricidad o Internet, el valor se acumula en las capas que la habilitan: la potencia de cómputo, la energía, los chips. La transición de aplicación a infraestructura es la tendencia definitoria de esta nueva era industrial. La curva exponencial de adopción se ha aplanado en un plateau, y ahora la carrera es construir los rieles que transportarán la próxima ola de innovación.

La Carrera por la Potencia de Cómputo: Métricas de Eficiencia que Definen Ganadores

La competencia por el dominio de la IA ya no se centra en el conteo bruto de chips. El nuevo campo de batalla es la eficiencia. A medida que los modelos de IA se hacen más grandes y complejos, las limitaciones fundamentales ya no son solo la capacidad de cómputo, sino la energía necesaria para entregarla. Este es el desafío central ingeniería y económico que define la próxima fase de infraestructura. Los centros de datos están mutando de simples granjas de servidores a sistemas energéticos de alta densidad, en los que la capacidad de empacar energía y de enfriarla eficientemente es el factor primario de competencia.

El cambio es contundente. En 2026, la infraestructura de IA ya no se define solo por la escala; se trata de densidad de energía, acceso a fuentes energéticas, ubicación geográfica, resiliencia, previsibilidad de costos y regulación. Entrenar y desplegar modelos de IA a escala requiere exponencialmente más cómputo y electricidad, llevando al límite tanto el diseño tradicional de los data centers como los sistemas eléctricos existentes. El antiguo modelo de agregar más servidores en instalaciones genéricas está obsoleto. La nueva necesidad es construir fábricas de IA—instalaciones dedicadas, ricas en energía, estratégicamente ubicadas cerca de fuentes energéticas para gestionar costos y garantizar estabilidad. Esto no es solo sobre centros de datos más grandes; es un cambio de paradigma en cómo concebimos la infraestructura física para la inteligencia digital.

Esta realidad física impulsa una evolución paralela en la arquitectura de cómputo. Los conceptos de “fábricas de IA” y “IA física” anticipados para GTC apuntan a un futuro donde la simulación se cruza con la robótica real. Los sistemas capaces de planificar, actuar y adaptarse en entornos complejos exigen nuevos tipos de chips diseñados para la velocidad y la eficiencia, no solo para operaciones aritméticas. Aquí es donde el supuesto nuevo chip enfocado en inferencia, posiblemente basado en la arquitectura Feynman, se vuelve crucial. Su propósito es ejecutar tareas de IA agentica—sistemas que actúan autónomamente—en el dispositivo o en el edge, reduciendo drásticamente la latencia y la dependencia del cloud. Las mejoras en eficiencia aquí no son solo técnicas; son económicas, disminuyendo el costo total de propiedad para desplegar IA a escala.

En síntesis, para los proveedores de infraestructura, el costo y la previsibilidad energética son ahora las métricas dominantes. La empresa que logre entregar más cómputo por watt, mientras gestiona la inmensa demanda de energía de estos sistemas, será la ganadora. Esta carrera se libra en dos frentes: el nivel del silicio, donde arquitecturas nuevas como Feynman prometen saltos en la eficiencia, y el nivel físico, donde el diseño de data centers y el abastecimiento energético definen la viabilidad operativa. La curva exponencial de adopción de la IA ha llegado a un punto en el que la eficiencia de la infraestructura es el único camino sostenible hacia adelante.

Dominio de Mercado y Amenazas Competitivas: El 81% de Participación y el Desafío del 20%

La posición de NVIDIA es de dominio casi absoluto. La compañía controla un 81% de participación de mercado por ingresos en chips para centros de datos, cifra que ha impulsado su acción hasta una valuación de $5 billones. Esto no es solo una ventaja; es un foso estructural construido sobre un ecosistema integrado de hardware, redes y la plataforma fundamental de software CUDA. El resultado es un ciclo de crecimiento impulsado, con ventas y ganancias aumentando más del 60% año a año y la empresa proyectando cerca de $500 mil millones en ingresos para 2026.

Sin embargo, incluso a esta escala, el panorama competitivo está cambiando. El rival más creíble es Advanced Micro Devices. AMD está ganando terreno rápidamente con sus aceleradores Instinct y ha asegurado una asociación de $10 mil millones con OpenAI. Esta no es una amenaza distante; es un asalto directo sobre la base de clientes de NVIDIA, con AMD ya firmando acuerdos con grandes clientes como Meta. La dinámica es clara: NVIDIANVDA-- ofrece estabilidad y dominio continuo, mientras AMD presenta una oportunidad de mayor riesgo y potencial de mayores retornos para inversores que buscan capitalizar el mercado en rápida expansión.

El riesgo más profundo y de más largo plazo, sin embargo, proviene del interior. Los principales gigantes tecnológicos están volcando cada vez más recursos para diseñar chips propios para sus centros de datos. Esta tendencia, impulsada por la necesidad de controlar costos y personalizar, amenaza con erosionar el ecosistema de NVIDIA con el tiempo. A medida que Alphabet, Google y otros despliegan su propio silicio personalizado, la dependencia del hardware de NVIDIA para cargas de trabajo centrales de IA podría disminuir gradualmente. Este es el clásico "trampa de plataforma" para proveedores de infraestructura: construís los rieles, pero los usuarios más grandes eventualmente pueden construir sus propias vías.

En conclusión: el 81% de participación de NVIDIA es un escudo poderoso, pero no es impenetrable. El desafío inmediato es un rival creíble y bien financiado como AMD. El desafío futuro es un potencial éxodo de los clientes más grandes hacia soluciones autodesarrolladas. Por ahora, la empresa proyecta ventas del primer trimestre por encima de las expectativas del mercado, lo que demuestra que el motor de demanda sigue rugiendo. Pero la carrera armamentista de la infraestructura recién comienza, y las reglas del juego están cambiando.

Catalizadores, Escenarios y Qué Observar

La verdadera prueba de la tesis de infraestructura de NVIDIA llega en el GTC. La conferencia es el terreno donde las curvas teóricas se encuentran con el despliegue físico. Los anuncios clave validarán si el roadmap de la empresa está alineado con las demandas exponenciales de la era industrial de la IA. Los inversores deben estar atentos a tres catalizadores críticos.

Primero, la arquitectura GPU de próxima generación. La métrica principal es la eficiencia energética. A medida que los modelos de IA crecen, el costo y las limitaciones físicas de entregar energía se convierten en la principal barrera. Toda nueva arquitectura, ya sea una mejora de Blackwell o un salto a través de la supuesta Feynman, debe demostrar una mejora significativa en cómputo por watt. Esta es la ganancia fundamental de eficiencia que define la viabilidad económica de escalar fábricas de IA. Si no hay avances aquí, se desafía toda la narrativa de la carrera por la potencia de cálculo.

Segundo, las sesiones sobre 'IA agentica' y 'inferencia' son la señal operativa. El paso de entrenar modelos masivos a desplegar agentes autónomos es la próxima fase de alta demanda de cómputo. Hay que buscar demostraciones concretas de sistemas que puedan planificar, actuar y adaptarse en entornos reales. Aquí es donde entran en juego los nuevos chips enfocados en inferencia. La capacidad de ejecutar estas complejas tareas en tiempo real, eficientemente en el dispositivo o en el edge, es el puente del laboratorio al impacto. Sesiones fuertes en este punto confirmarían un flujo masivo y recurrente de ingresos más allá de la capacitación inicial de modelos.

Finalmente, la magnitud del evento es un dato en sí mismo. Con más de 30.000 asistentes de más de 190 países, GTC es un barómetro vivo del despliegue global de infraestructura. No es solo una conferencia para desarrolladores; es un evento de movilización de fuerzas laborales. Las sesiones sobre capacitación, certificación y engagement de startups subrayan el enorme capital humano necesario para apoyar esta expansión. El número de asistentes valida la idea de que la IA está volviéndose infraestructura esencial, requiriendo un despliegue industrial de talento y sistemas físicos.

En resumen, GTC mostrará si NVIDIA es solo un proveedor o el conductor indispensable de esta nueva era industrial. Los anuncios sobre eficiencia, las demostraciones prácticas de sistemas agenticos y la escala de la participación determinarán colectivamente si el dominio de la empresa se está consolidando, o si nuevos competidores están logrando ganar posiciones en la próxima curva S.

Descargo de responsabilidad: El contenido de este artículo refleja únicamente la opinión del autor y no representa en modo alguno a la plataforma. Este artículo no se pretende servir de referencia para tomar decisiones de inversión.

También te puede gustar

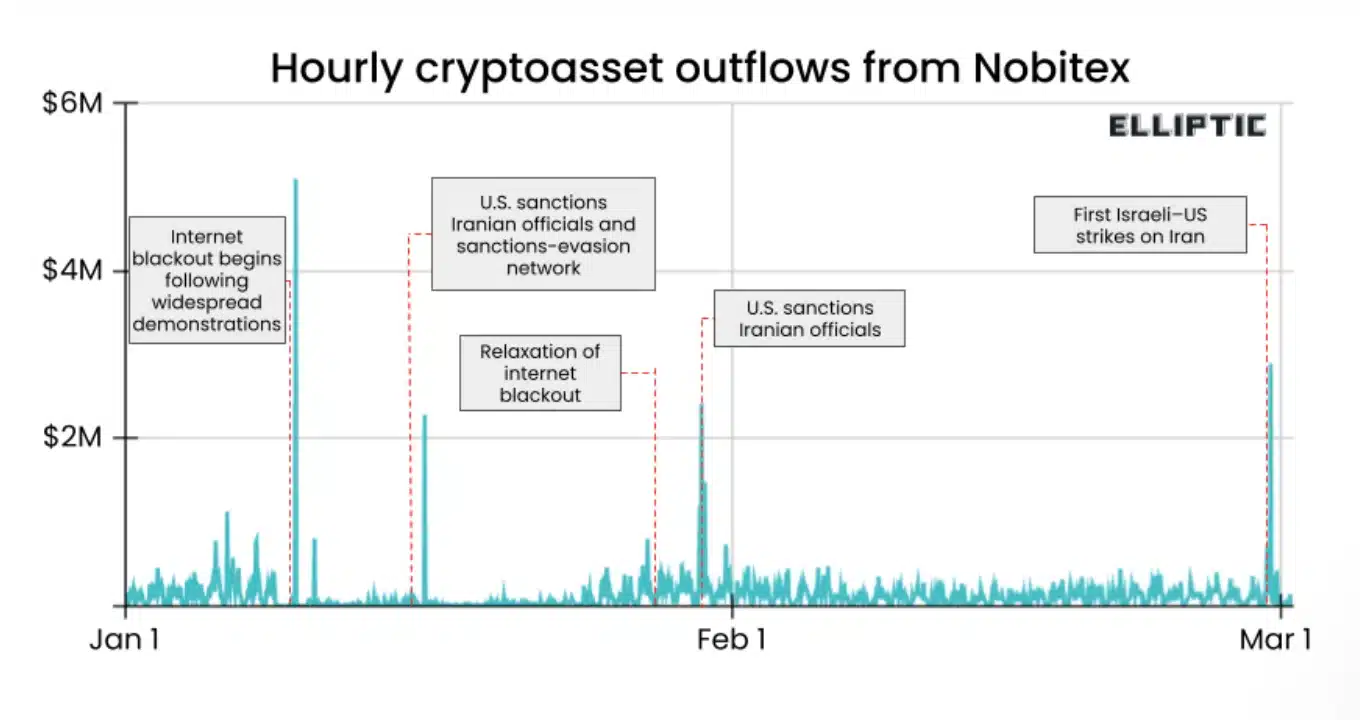

El mercado cripto de Irán se dispara un 700% después de los ataques – ¿Es esto fuga de capital o…

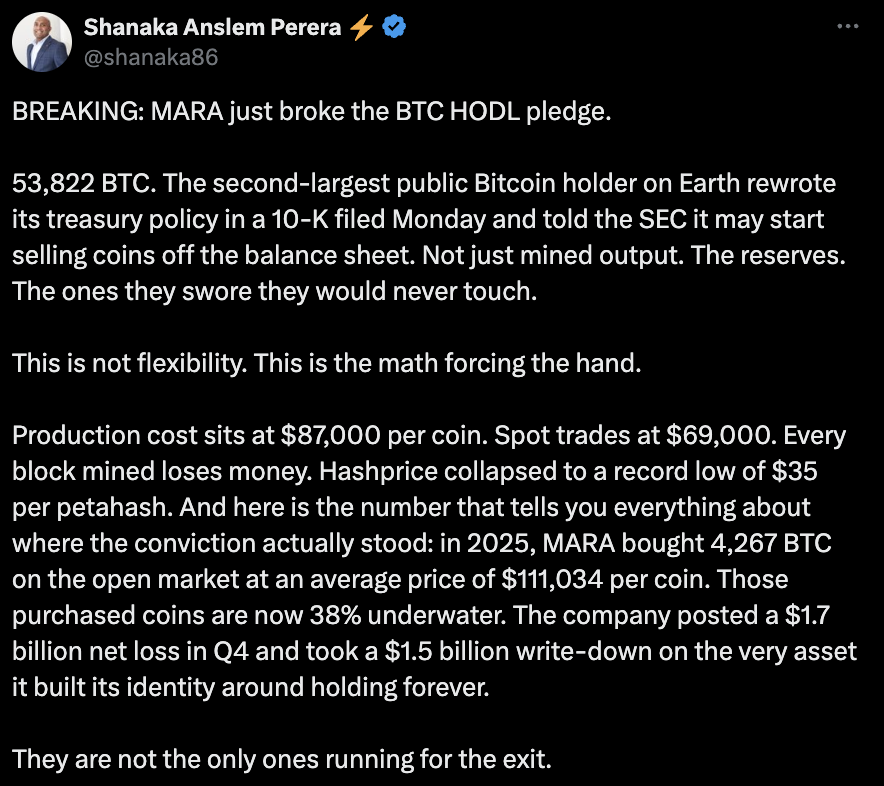

Las empresas mineras se adentran más en IA y HPC mientras MARA podría vender Bitcoin

Las acciones de MongoDB caen un 27% por bajo crecimiento en el negocio en la nube y previsiones moderadas