SK Hynix asegura 2/3 del suministro de HBM4 de Nvidia—Por qué esta asignación señala una dominancia a largo plazo en infraestructura de IA

La próxima fase de la curva S de cómputo en IA depende de una sola y crítica capa de infraestructura: memoria de alto ancho de banda. La asignación de Nvidia para su plataforma Vera Rubin representa una muestra de confianza en las empresas capaces de construir esta capa a escala. El objetivo no es solo más memoria, sino un salto masivo en el ancho de banda. El sistema en rack VR200 NVL72 está diseñado para alcanzar más de 22 terabytes por segundo de ancho de banda de sistema, una cifra que refleja la demanda exponencial de datos que van y vienen hacia los aceleradores de IA. No se trata de una mejora incremental; es un cambio de paradigma en la intensidad de memoria.

Ganar un lugar en este nuevo carril de última generación es una carrera por la producción masiva estable y de alto rendimiento, no solo una competencia tecnológica. La distribución de la asignación de Nvidia-aproximadamente dos tercios de su demanda de HBM4 a SK Hynix y el resto a Samsung-refleja este nuevo cálculo. La decisión es una muestra de confianza en las alianzas establecidas de SK Hynix y, más importante aún, en su probada capacidad para entregar a escala. Analistas destacan que este movimiento refleja confianza en las asociaciones de SK hynix con HBM a largo plazo y la confianza construida sobre rendimientos consistentemente altos en la producción a gran escala. SK Hynix ya había implementado su sistema de producción masiva HBM4 y entregado muestras validadas, un prerrequisito para la producción a gran escala.

Para Samsung, la asignación es una contraofensiva. La empresa apunta al máximo rendimiento con un proceso de vanguardia y ha asegurado envíos oficiales de HBM4 el próximo mes a grandes clientes de chips de IA como NVIDIANVDA-3.01%. El hecho de que ambos proveedores estén enviando ahora a precios comparables indica que el mercado está superando la mera competencia de costos. La ventaja competitiva central ahora es la capacidad de escalar la producción de manera confiable y cumplir con los agresivos cronogramas de los desarrolladores de plataformas de IA.

En resumen, HBM4 representa el contenido de memoria de mayor ingreso y mayor margen en estos sistemas. Quedar fuera de esta capa significa quedarse atrás en la curva de crecimiento exponencial. Para los proveedores, es una elección tajante: dominar la fabricación compleja y de alto rendimiento requerida para el próximo paradigma o ser relegado a segmentos de menor valor. La asignación de Nvidia es una señal clara de dónde se están colocando las vías.

La ventaja competitiva: capacidad, rendimientos y calificación técnica

La carrera por la dominancia en HBM4 se está ganando en métricas tangibles de escala, fortaleza financiera y calificación técnica. SK Hynix y Samsung tienen una ventaja decisiva sobre Micron, no solo en ambición sino en ejecución actual y posición de mercado.

Financieramente, el dominio de SK Hynix es claro. La empresa reportó una ganancia operativa récord de 47.2 billones de wones en el año completo, superando los 43.6 billones de won de Samsung. Esto no es solo un resultado trimestral; refleja un modelo de negocio enfocado y basado en IA. Mientras Samsung opera en electrónica de consumo y manufactura por contrato, el enfoque singular de SK Hynix en chips de memoria le ha permitido capturar el segmento de mayor margen en el boom de la IA. Este músculo financiero financia su agresiva expansión, planeando incrementar su inversión en infraestructura más de cuatro veces respecto a su nivel previo. Samsung sigue el ritmo, buscando expandir su capacidad de producción alrededor de un 50% en 2026. Ambos están construyendo nuevas fábricas, pero la escala de inversión de SK Hynix señala un compromiso con asegurar su liderazgo ante la próxima restricción de capacidad.

El obstáculo técnico para la plataforma Vera Rubin de Nvidia es el filtro final y crítico. La empresa exige velocidades de datos HBM4 que superan los 10Gb/s, un salto significativo desde el estándar de 8Gb/s. Aquí es donde el panorama competitivo se afila. Los reportes de la industria indican que Samsung ha aprobado efectivamente las pruebas de calificación de HBM4 de NVIDIA a estas altas velocidades. SK Hynix todavía está optimizando su producto para cumplir los benchmarks más estrictos. Para Micron, la brecha es mayor. Si bien se espera que la empresa suministre HBM4 para aceleradores de gama media, no ha superado la barrera de calificación para la plataforma insignia Vera Rubin. Esta calificación técnica es la puerta de entrada a los sistemas de mayor ingreso y rendimiento.

En conclusión, SK Hynix y Samsung están construyendo las vías para el próximo paradigma de IA, mientras Micron es dirigida a un carril de menor categoría. Sus planes combinados de expansión de capacidad, respaldados por ganancias récord, están diseñados para responder a la demanda exponencial. La calificación técnica para Vera Rubin es la primera gran prueba de esa preparación, y la evidencia actual muestra que los dos gigantes coreanos llevan la delantera.

El giro de Micron y la alternativa LPDDR5X

El realineamiento estratégico de Micron es una respuesta directa a haber quedado fuera del tren HBM4. En diciembre de 2025, la empresa anunció planes para salir del mercado de memoria y almacenamiento de consumo para concentrar sus recursos en clientes de centros de datos de IA. Este giro es una jugada clásica para redoblar la apuesta en la curva de crecimiento exponencial, pero deja a la empresa navegando un carril diferente—uno con apuestas fundamentalmente más bajas en ancho de banda y economía.

El tema central es uno de arquitectura de sistema y economía. LPDDR5X, que Micron suministra para las CPUs Vera de Nvidia, opera en un nivel completamente diferente de la pila de memoria. Es una solución eficiente en energía y sensible en costos, diseñada para cargas de trabajo móviles y servidores de entrada. En contraste, HBM4 es la columna vertebral de alta capacidad y alto margen de los sistemas de IA de próxima generación. La diferencia económica es marcada: HBM genera ingresos muy altos por unidad y márgenes sustancialmente mayores que la DRAM convencional, y LPDDR5X ocupa un rango aún más bajo en esa escala de valor. Para un sistema como el VR200 NVL72 rack, que apunta a más de 22 terabytes por segundo de ancho de banda del sistema, LPDDR5X simplemente no puede cumplir con las demandas de rendimiento. Ocupa una posición diferente en la arquitectura del sistema, no una competidora.

Esto lleva directamente a la probabilidad de una falla de calificación. Los objetivos extremos de ancho de banda de la plataforma Vera Rubin, impulsados por su diseño de 72 GPU, favorecen a HBM sobre cualquier otra alternativa. Los problemas reportados de rendimiento y de eficiencia en el desarrollo de HBM4 de Micron probablemente retrasaron su calificación en comparación con SK Hynix y Samsung, quienes ya aseguraron victorias de diseño. Dado que el suministro de HBM4 para la plataforma se divide entre estos dos, con aproximadamente un 70% del mercado para SK hynix, el camino para que Micron se una a los sistemas insignia Vera Rubin parece cerrado. Su rol con LPDDR5X es de apoyo, no como habilitador central de rendimiento.

La conclusión para Micron es una concesión dolorosa. Al salir del mercado de consumo, está enfocando su capital e ingeniería en el centro de datos de IA, pero ha sido excluida del segmento de mayor valor de ese mercado. Su suministro de LPDDR5X es un negocio viable y en crecimiento, pero se trata de una jugada de bajo margen y bajo ancho de banda que no participa en la escalada exponencial de ancho de banda del paradigma Vera Rubin. En la carrera por la infraestructura de IA, quedarse fuera del carril HBM4 implica ser relegado a una vía diferente, menos lucrativa.

Catalizadores, escenarios y qué observar

La prueba inmediata para el dominio de HBM4 de SK Hynix y Samsung comienza este mes. Con la producción de HBM4 tomando más de seis meses desde la oblea hasta el empaque final, se espera que ambas empresas inicien producción tan pronto como este mes. Las métricas críticas serán los rendimientos y los límites de capacidad. Samsung ya inició envíos en febrero, dándole una pequeña ventaja. SK Hynix, aunque aún está optimizando su producto para cumplir los exigentes estándares de 11Gb/s, debe ahora demostrar que puede escalar confiablemente. Cualquier traspié en rendimiento o capacidad aquí cuestionaría directamente la tesis de su producción estable y de alto rendimiento a gran escala.

De cara a 2026, la proyección de participación de mercado muestra un liderazgo claro, aunque menos dominante, para SK Hynix. Según TrendForce, se espera que la empresa capture el 50% de la producción global de bits HBM, una disminución desde el 59% de participación en 2025. Mientras tanto, la parte de Samsung está proyectada a subir del 20% al 28%. Este cambio subraya la dinámica competitiva: SK Hynix sigue siendo el líder en volumen, pero Samsung está ganando terreno, especialmente en la plataforma insignia Vera Rubin. El principal riesgo para esta configuración es que problemas de rendimiento o restricciones de capacidad en cualquiera de las empresas abran temporalmente una oportunidad para LPDDR5X de Micron en aplicaciones de nicho. Aunque LPDDR5X no puede cumplir con las demandas de ancho de banda extremo del VR200 NVL72 rack, podría encontrar un hueco en aceleradores de inferencia de gama media, ya que se espera que Micron provea para la plataforma Rubin CPX.

La clave es que los próximos meses confirmarán si SK Hynix y Samsung pueden traducir sus cualificaciones técnicas y fortaleza financiera en una producción impecable y a gran escala. El catalizador será el propio aumento de producción. El éxito significa consolidar su posición como las únicas vías para el nuevo paradigma de IA. El fracaso abre una puerta, aunque estrecha, a soluciones alternativas. Por ahora, la curva de crecimiento exponencial permanece firmemente en sus manos.

Descargo de responsabilidad: El contenido de este artículo refleja únicamente la opinión del autor y no representa en modo alguno a la plataforma. Este artículo no se pretende servir de referencia para tomar decisiones de inversión.

También te puede gustar

¿Puede la acumulación de pedidos sin precedentes de Comfort Systems sostener una fuerte demanda?

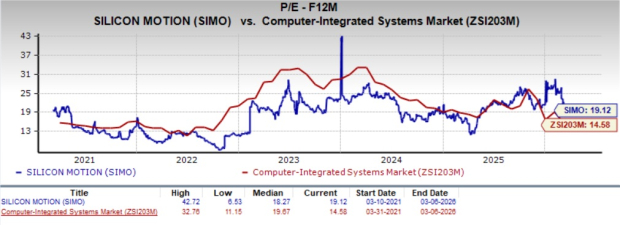

¿Podrán los avances de Silicon Motion en almacenamiento para IA impulsar su futura expansión?

Ovintiv sube un 26% en tres meses: ¿Es momento de comprar o mantener las acciones?